Pourquoi nous ne sommes pas des machines

(Et pourquoi c'est une excellente nouvelle)

Vous avez déjà essayé de discuter avec votre grille-pain ? Probablement pas. Ou alors, c'était une soirée difficile. Pourtant, quand vous parlez à ChatGPT, Siri ou Alexa, vous avez l'impression qu'il y a quelqu'un. Une intelligence. Une présence.

Et très vite, une petite musique s'installe dans votre tête : "Au fond, quelle est la différence ? Mon cerveau n'est-il pas juste un ordinateur fait de viande ? Mes neurones ne sont-ils pas des câbles biologiques ? Et si, finalement, j'étais moi aussi une machine, juste un peu plus complexe et buggée que les autres ?"

Cette idée – l'homme-machine – est partout. Elle est fascinante. Elle est séduisante.

Et elle est totalement fausse.

Pire : elle est dangereuse.

Ce texte n'est pas une attaque contre la technologie. J'adore la technologie. Ce texte est une opération de sauvetage. Il s'agit de sauver ce qui fait de nous des humains, avant que nous ne finissions par nous prendre pour des applications obsolètes.

Attachez votre ceinture (biologique), nous partons pour un voyage à travers la physique, la biologie, l'histoire et la politique.

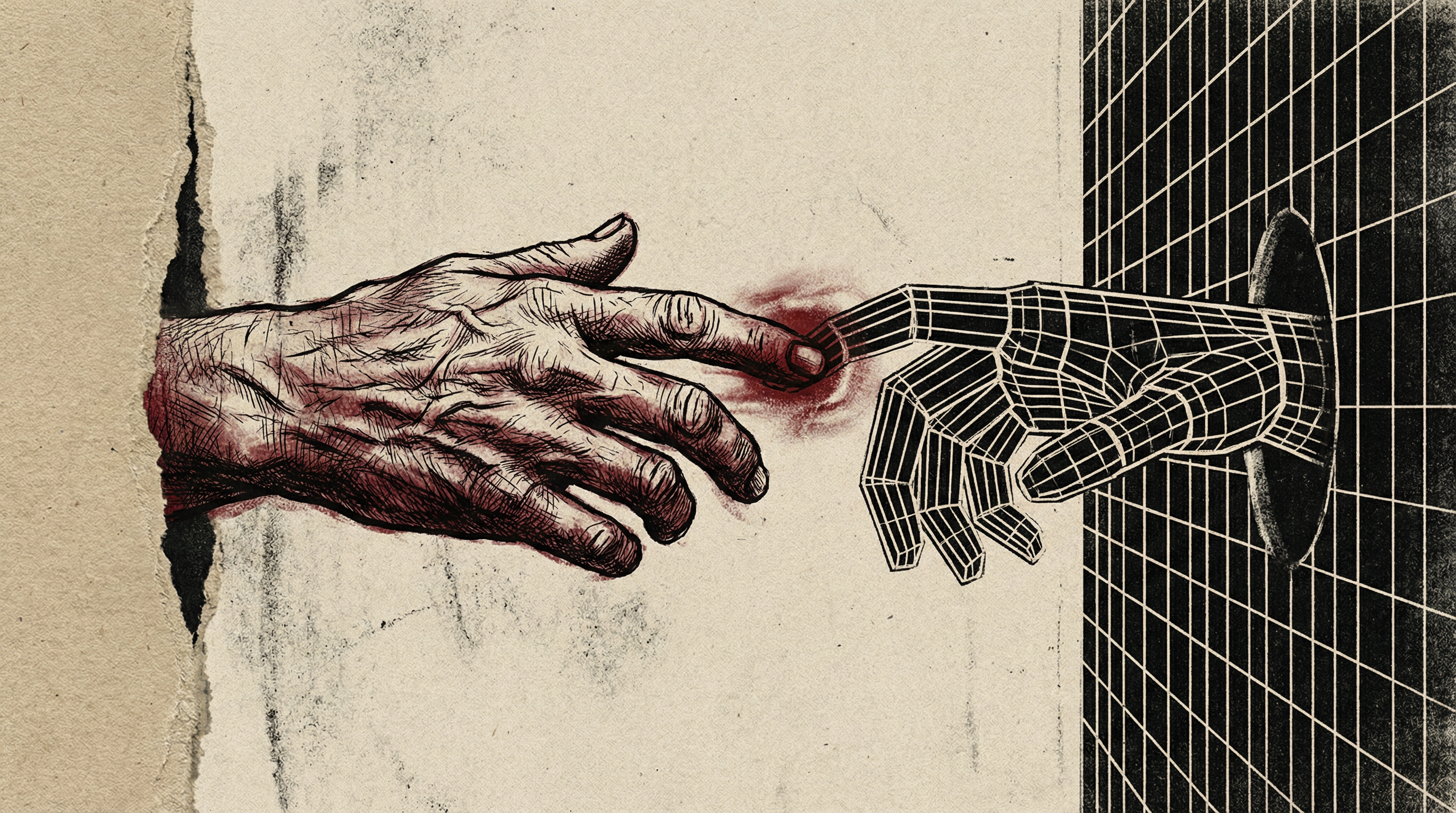

Figure 1: La machine et le vivant (IA)

1. L'illusion du perroquet (ou pourquoi ChatGPT ne comprend rien)

Imaginez un perroquet surdoué. Il a lu (ou plutôt ingéré) toute la bibliothèque d'Alexandrie, tout Wikipédia, et tous les forums Reddit (le pauvre). Si vous lui demandez : "Quelle est la capitale de la France ?", il va répéter "Paris". Est-ce qu'il sait ce qu'est une capitale ? Non. Est-ce qu'il sait ce qu'est la France ? Non. Il a juste repéré que, statistiquement, après les mots "capitale" et "France", le mot "Paris" apparaît très souvent.

Les modèles de langage (LLM) comme GPT-4 sont des perroquets stochastiques (c'est le terme scientifique, ça fait très chic en dîner). Ils calculent la probabilité du mot suivant. Ils ne manipulent pas des sens, ils manipulent des signes.

Pour une machine, le mot "pomme" est une suite de 0 et de 1. Pour vous, "pomme" c'est : un fruit, une couleur, le souvenir de la tarte de votre grand-mère, le péché originel, la marque de votre téléphone, ou Jacques Chirac. Le mot est chargé d'une épaisseur de monde. Pour la machine, il est plat comme un écran.

2. L'ordinateur ne pense pas, il calcule (et ce n'est pas pareil)

Calculer, c'est suivre une règle. Penser, c'est parfois inventer la règle, ou la briser. Une calculatrice ne se trompe jamais (sauf si elle est cassée). Un humain se trompe tout le temps, et c'est pour ça qu'il invente. L'erreur, l'hésitation, le doute, le vagabondage mental ne sont pas des bugs du cerveau humain. Ce sont les conditions mêmes de notre créativité.

Si vous demandez à une IA de dessiner un chat, elle va faire la moyenne de millions d'images de chats. Elle fera le chat le plus "chat" possible. Si vous demandez à Picasso de dessiner un chat, il va faire trois traits tordus qui ne ressemblent à rien, mais qui capturent l'essence féline mieux qu'une photo. L'IA vise la moyenne. L'art (et la pensée humaine) vise la singularité.